Narzędzia oparte na sztucznej inteligencji coraz częściej zastępują wyszukiwarki, gdy szukamy informacji o lekach, objawach czy profilaktyce. Eksperci ostrzegają jednak, że nawet najbardziej zaawansowane modele potrafią „halucynować” – generować przekonujące, lecz fałszywe treści. Odpowiedzi pozbawione wiarygodnych źródeł mogą prowadzić do błędnych decyzji zdrowotnych, zwłaszcza gdy użytkownik nie weryfikuje ich z profesjonalistą.

Premium Health Sources – nowa warstwa weryfikacji

Aby ograniczyć ryzyko dezinformacji, Perplexity AI wprowadza funkcję Premium Health Sources. Rozszerzenie aktywuje się automatycznie, gdy użytkownik porusza w rozmowie wątek medyczny: od chorób przewlekłych, przez dawkowanie leków, aż po interpretację wyników badań. System kieruje zapytania do zamkniętych baz danych, takich jak BMJ Best Practice czy New England Journal of Medicine, oraz do klinicznych wytycznych rekomendowanych przez towarzystwa naukowe. Wygenerowana odpowiedź otrzymuje przegląd cytowanych pozycji, dzięki czemu można od razu sprawdzić, skąd pochodzą kluczowe dane.

Dostęp do literatury za paywallem i automatyczne cytowanie

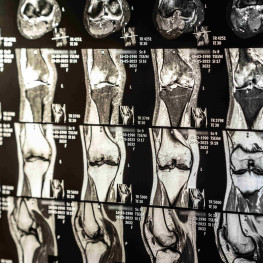

Większość wysokiej jakości publikacji medycznych jest ukryta za płatnymi subskrypcjami, co utrudnia pacjentom dotarcie do rzetelnych treści. Perplexity uzyskało licencje na przekazywanie streszczeń oraz fragmentów artykułów z czasopism branżowych w formie zsyntetyzowanej odpowiedzi. Model językowy nie opiera się więc wyłącznie na otwartych blogach czy forum dyskusyjnych, ale na recenzowanych badaniach i oficjalnych protokołach. Co istotne, mechanizm cytowania podlega dodatkowej kontroli: zanim źródło zostanie wyświetlone użytkownikowi, algorytm weryfikuje numer DOI i zgodność przywołanego fragmentu z oryginałem, minimalizując ryzyko przypisania nieistniejących referencji.

Korzyści dla pacjentów i personelu medycznego

Dla laików największą zmianą jest klarowność przekazu. Zamiast przeszukiwać setki stron, otrzymują oni streszczenie najnowszych zaleceń z odniesieniami do fundamentów naukowych. Z kolei lekarzy i farmaceutów może zainteresować szybkie porównanie rekomendacji różnych towarzystw w jednej odpowiedzi, co ułatwia aktualizację wiedzy między dyżurami. Firma deklaruje, że nad poprawnością merytoryczną czuwa interdyscyplinarny zespół lekarzy, farmaceutów i inżynierów, którzy testują system na rzeczywistych scenariuszach klinicznych.

Granice odpowiedzialności i dalsze wyzwania

Nawet najbardziej rygorystyczny proces selekcji źródeł nie eliminuje wszystkich zagrożeń. Model może zinterpretować objawy w sposób zbyt ogólny lub pominąć rzadkie schorzenie, jeśli nie pojawia się ono wystarczająco często w literaturze. Dodatkowo algorytm, choć oparty na danych sprzed kilku tygodni, nie zastąpi bieżącej oceny lekarza, który bierze pod uwagę historię pacjenta, wyniki badań fizykalnych i kontekst psychospołeczny. Perplexity AI podkreśla w materiałach prasowych, że odpowiedzi należy traktować jako narzędzie pomocnicze, a nie ostateczną diagnozę czy plan leczenia. W komunikacie firma zaleca konsultację z wykwalifikowanym specjalistą przed podjęciem jakiejkolwiek decyzji terapeutycznej.

Przyszłość medycznych chatbotów

Rynek rozwiązań AI dla ochrony zdrowia rozwija się dynamicznie: duże centra badawcze testują modele wyspecjalizowane w kardiologii, onkologii czy toksykologii, a regulatorzy zastanawiają się nad ramami prawnymi dla „cyfrowych asystentów”. Integracja z płatnymi bazami danych może stać się standardem, ale równie ważne będą transparentność algorytmu i jasno określona odpowiedzialność prawna. Dopiero połączenie wysokiej jakości źródeł, audytu eksperckiego i świadomego użytkownika stworzy środowisko, w którym technologia wspiera, a nie zastępuje, profesjonalną opiekę medyczną.